- Principales informations

- Getting Started

- Agent

- API

- Tracing

- Conteneurs

- Dashboards

- Database Monitoring

- Datadog

- Site Datadog

- DevSecOps

- Incident Management

- Intégrations

- Internal Developer Portal

- Logs

- Monitors

- OpenTelemetry

- Profileur

- Session Replay

- Security

- Serverless for AWS Lambda

- Software Delivery

- Surveillance Synthetic

- Tags

- Workflow Automation

- Learning Center

- Support

- Glossary

- Standard Attributes

- Guides

- Agent

- Intégrations

- Développeurs

- OpenTelemetry

- Administrator's Guide

- API

- Partners

- Application mobile

- DDSQL Reference

- CoScreen

- CoTerm

- Remote Configuration

- Cloudcraft

- In The App

- Dashboards

- Notebooks

- DDSQL Editor

- Reference Tables

- Sheets

- Alertes

- Watchdog

- Métriques

- Bits AI

- Internal Developer Portal

- Error Tracking

- Change Tracking

- Service Management

- Actions & Remediations

- Infrastructure

- Cloudcraft

- Resource Catalog

- Universal Service Monitoring

- Hosts

- Conteneurs

- Processes

- Sans serveur

- Surveillance réseau

- Cloud Cost

- Application Performance

- APM

- Termes et concepts de l'APM

- Sending Traces to Datadog

- APM Metrics Collection

- Trace Pipeline Configuration

- Connect Traces with Other Telemetry

- Trace Explorer

- Recommendations

- Code Origin for Spans

- Observabilité des services

- Endpoint Observability

- Dynamic Instrumentation

- Live Debugger

- Suivi des erreurs

- Sécurité des données

- Guides

- Dépannage

- Profileur en continu

- Database Monitoring

- Agent Integration Overhead

- Setup Architectures

- Configuration de Postgres

- Configuration de MySQL

- Configuration de SQL Server

- Setting Up Oracle

- Setting Up Amazon DocumentDB

- Setting Up MongoDB

- Connecting DBM and Traces

- Données collectées

- Exploring Database Hosts

- Explorer les métriques de requête

- Explorer des échantillons de requêtes

- Exploring Database Schemas

- Exploring Recommendations

- Dépannage

- Guides

- Data Streams Monitoring

- Data Jobs Monitoring

- Data Observability

- Digital Experience

- RUM et Session Replay

- Surveillance Synthetic

- Continuous Testing

- Product Analytics

- Software Delivery

- CI Visibility

- CD Visibility

- Deployment Gates

- Test Visibility

- Code Coverage

- Quality Gates

- DORA Metrics

- Feature Flags

- Securité

- Security Overview

- Cloud SIEM

- Code Security

- Cloud Security Management

- Application Security Management

- Workload Protection

- Sensitive Data Scanner

- AI Observability

- Log Management

- Pipelines d'observabilité

- Log Management

- CloudPrem

- Administration

Data Streams Monitoring pour Kafka

Ce produit n'est pas pris en charge par le site Datadog que vous avez sélectionné. ().

Prérequis

| Langage | Bibliothèque | Version minimale du traceur | Version recommandée du traceur |

|---|---|---|---|

| Java | kafka-clients (La génération de lag n'est pas prise en charge pour la v3.7*) | 1.9.0 | 1.43.0 or later |

| Go | confluent-kafka-go | 1.56.1 | 1.66.0 or later |

| Sarama | 1.56.1 | 1.66.0 or later | |

| kafka-go | 1.63.0 | 1.63.0 or later | |

| Node.js | kafkajs | 2.39.0 or 3.26.0 or 4.5.0 | 5.25.0 or later |

| confluent-kafka-javascript | 5.52.0 | 5.52.0 or later | |

| Python | confluent-kafka | 1.16.0 | 2.11.0 or later |

| aiokafka | 4.1.0 | 4.1.0 or later | |

| .NET | Confluent.Kafka | 2.28.0 | 2.41.0 or later |

| Ruby | Ruby Kafka | 2.23.0 | 2.23.0 or later |

| Karafka | 2.23.0 | 2.23.0 or later |

*Spring Boot 3.3.x et spring-kafka 3.2.x utilisent kafka-clients 3.7.x, qui ne prend pas en charge la génération de lag. Pour résoudre ce problème, mettez à jour votre version de kafka-clients vers la version 3.8.0 ou ultérieure.

Kafka Streams est partiellement pris en charge pour Java et peut entraîner des lacunes dans les mesures de latence.

Déploiements Kafka pris en charge

L’instrumentation de vos consommateurs et producteurs avec Data Streams Monitoring vous permet de visualiser votre topologie et de suivre vos pipelines avec des métriques prêtes à l’emploi, quel que soit le mode de déploiement de Kafka. De plus, les déploiements Kafka suivants bénéficient d’une intégration plus poussée, offrant davantage d’informations sur l’état de votre cluster Kafka :

| Modèle | Intégration |

|---|---|

| Auto-hébergé | Kafka Broker & Kafka Consumer |

| Confluent Platform | Confluent Platform |

| Confluent Cloud | Confluent Cloud |

| Amazon MSK | Amazon MSK ou Amazon MSK (Agent) |

| Red Panda | Pas encore intégré |

Configurer Data Streams Monitoring

Consultez les instructions de configuration pour Java, Go, Node.js, Python, .NET ou Ruby.

Monitoring Kafka Pipelines

Data Streams Monitoring uses message headers to propagate context through Kafka streams. If log.message.format.version is set in the Kafka broker configuration, it must be set to 0.11.0.0 or higher. Data Streams Monitoring is not supported for versions lower than this.

Surveillance des connecteurs

Connecteurs Confluent Cloud

Data Streams Monitoring can automatically discover your Confluent Cloud connectors and visualize them within the context of your end-to-end streaming data pipeline.

Setup

Install and configure the Datadog-Confluent Cloud integration.

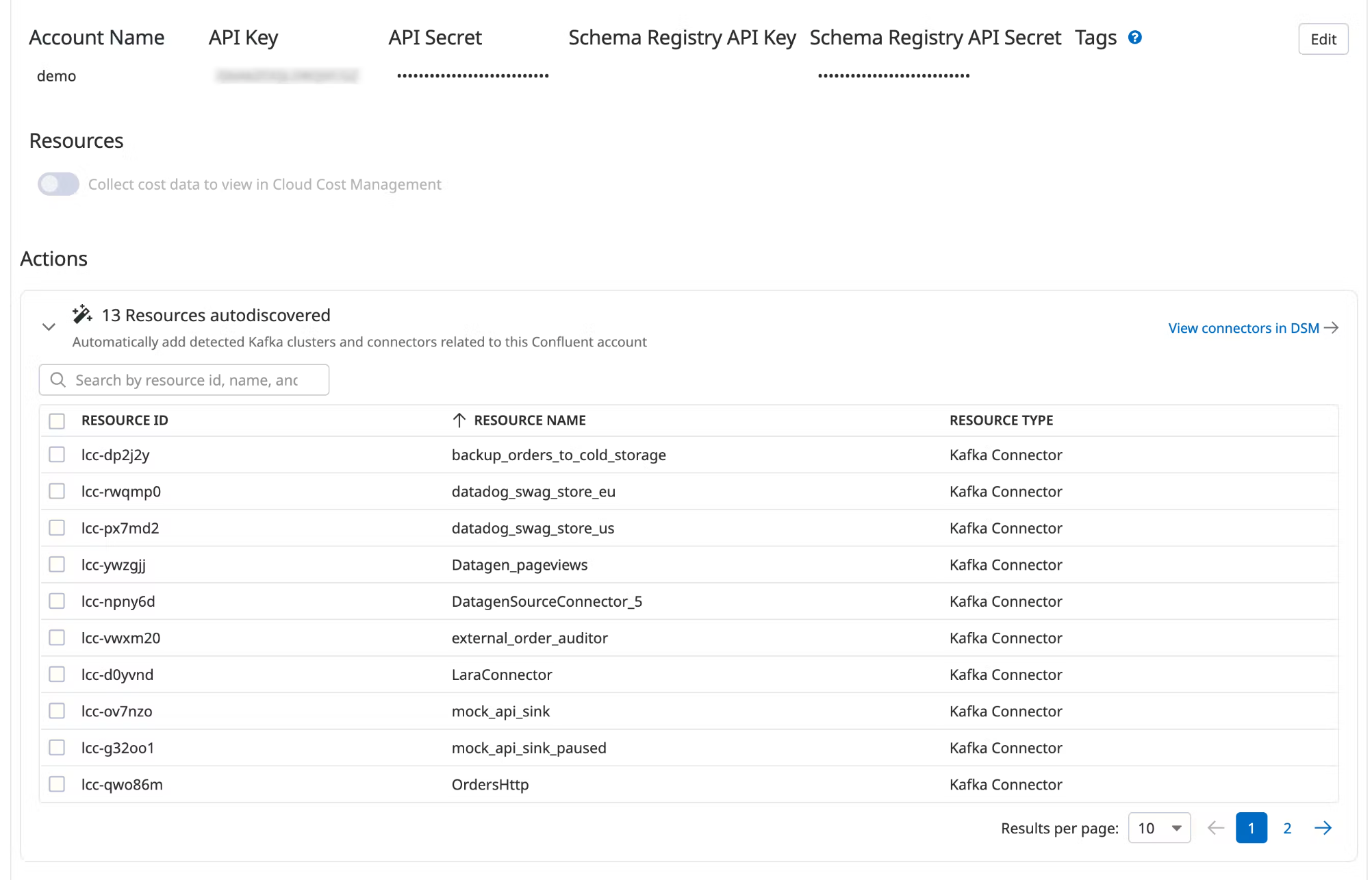

In Datadog, open the Confluent Cloud integration tile.

Under Actions, a list of resources populates with detected clusters and connectors. Datadog attempts to discover new connectors every time you view this integration tile.

Select the resources you want to add.

Click Add Resources.

Navigate to Data Streams Monitoring to visualize the connectors and track connector status and throughput.

Connecteurs Kafka auto-hébergés

Prérequis : dd-trace-java v1.44.0+

Cette fonctionnalité est en version Preview.

Data Streams Monitoring peut collecter des informations à partir de vos connecteurs Kafka auto-hébergés. Dans Datadog, ces connecteurs apparaissent sous forme de services connectés à des topics Kafka. Datadog collecte le débit vers et depuis tous les topics Kafka. Datadog ne collecte pas le statut des connecteurs ni les sinks et sources des connecteurs Kafka auto-hébergés.

Configuration

- Assurez-vous que l’Agent Datadog est en cours d’exécution sur vos workers Kafka Connect.

- Vérifiez que

dd-trace-javaest installé sur vos workers Kafka Connect. - Modifiez vos options Java pour inclure

dd-trace-javasur vos nœuds worker Kafka Connect. Par exemple, sur Strimzi, modifiezSTRIMZI_JAVA_OPTSpour ajouter-javaagent:/path/to/dd-java-agent.jar.