- Esenciales

- Empezando

- Agent

- API

- Rastreo de APM

- Contenedores

- Dashboards

- Monitorización de bases de datos

- Datadog

- Sitio web de Datadog

- DevSecOps

- Gestión de incidencias

- Integraciones

- Internal Developer Portal

- Logs

- Monitores

- OpenTelemetry

- Generador de perfiles

- Session Replay

- Security

- Serverless para Lambda AWS

- Software Delivery

- Monitorización Synthetic

- Etiquetas (tags)

- Workflow Automation

- Centro de aprendizaje

- Compatibilidad

- Glosario

- Atributos estándar

- Guías

- Agent

- Arquitectura

- IoT

- Plataformas compatibles

- Recopilación de logs

- Configuración

- Automatización de flotas

- Solucionar problemas

- Detección de nombres de host en contenedores

- Modo de depuración

- Flare del Agent

- Estado del check del Agent

- Problemas de NTP

- Problemas de permisos

- Problemas de integraciones

- Problemas del sitio

- Problemas de Autodiscovery

- Problemas de contenedores de Windows

- Configuración del tiempo de ejecución del Agent

- Consumo elevado de memoria o CPU

- Guías

- Seguridad de datos

- Integraciones

- Desarrolladores

- Autorización

- DogStatsD

- Checks personalizados

- Integraciones

- Build an Integration with Datadog

- Crear una integración basada en el Agent

- Crear una integración API

- Crear un pipeline de logs

- Referencia de activos de integración

- Crear una oferta de mercado

- Crear un dashboard de integración

- Create a Monitor Template

- Crear una regla de detección Cloud SIEM

- Instalar la herramienta de desarrollo de integraciones del Agente

- Checks de servicio

- Complementos de IDE

- Comunidad

- Guías

- OpenTelemetry

- Administrator's Guide

- API

- Partners

- Aplicación móvil de Datadog

- DDSQL Reference

- CoScreen

- CoTerm

- Remote Configuration

- Cloudcraft

- En la aplicación

- Dashboards

- Notebooks

- Editor DDSQL

- Reference Tables

- Hojas

- Monitores y alertas

- Watchdog

- Métricas

- Bits AI

- Internal Developer Portal

- Error Tracking

- Explorador

- Estados de problemas

- Detección de regresión

- Suspected Causes

- Error Grouping

- Bits AI Dev Agent

- Monitores

- Issue Correlation

- Identificar confirmaciones sospechosas

- Auto Assign

- Issue Team Ownership

- Rastrear errores del navegador y móviles

- Rastrear errores de backend

- Manage Data Collection

- Solucionar problemas

- Guides

- Change Tracking

- Gestión de servicios

- Objetivos de nivel de servicio (SLOs)

- Gestión de incidentes

- De guardia

- Status Pages

- Gestión de eventos

- Gestión de casos

- Actions & Remediations

- Infraestructura

- Cloudcraft

- Catálogo de recursos

- Universal Service Monitoring

- Hosts

- Contenedores

- Processes

- Serverless

- Monitorización de red

- Cloud Cost

- Rendimiento de las aplicaciones

- APM

- Términos y conceptos de APM

- Instrumentación de aplicación

- Recopilación de métricas de APM

- Configuración de pipelines de trazas

- Correlacionar trazas (traces) y otros datos de telemetría

- Trace Explorer

- Recommendations

- Code Origin for Spans

- Observabilidad del servicio

- Endpoint Observability

- Instrumentación dinámica

- Live Debugger

- Error Tracking

- Seguridad de los datos

- Guías

- Solucionar problemas

- Límites de tasa del Agent

- Métricas de APM del Agent

- Uso de recursos del Agent

- Logs correlacionados

- Stacks tecnológicos de llamada en profundidad PHP 5

- Herramienta de diagnóstico de .NET

- Cuantificación de APM

- Go Compile-Time Instrumentation

- Logs de inicio del rastreador

- Logs de depuración del rastreador

- Errores de conexión

- Continuous Profiler

- Database Monitoring

- Gastos generales de integración del Agent

- Arquitecturas de configuración

- Configuración de Postgres

- Configuración de MySQL

- Configuración de SQL Server

- Configuración de Oracle

- Configuración de MongoDB

- Setting Up Amazon DocumentDB

- Conexión de DBM y trazas

- Datos recopilados

- Explorar hosts de bases de datos

- Explorar métricas de consultas

- Explorar ejemplos de consulta

- Exploring Database Schemas

- Exploring Recommendations

- Solucionar problemas

- Guías

- Data Streams Monitoring

- Data Jobs Monitoring

- Data Observability

- Experiencia digital

- Real User Monitoring

- Pruebas y monitorización de Synthetics

- Continuous Testing

- Análisis de productos

- Entrega de software

- CI Visibility

- CD Visibility

- Deployment Gates

- Test Visibility

- Configuración

- Network Settings

- Tests en contenedores

- Repositories

- Explorador

- Monitores

- Test Health

- Flaky Test Management

- Working with Flaky Tests

- Test Impact Analysis

- Flujos de trabajo de desarrolladores

- Cobertura de código

- Instrumentar tests de navegador con RUM

- Instrumentar tests de Swift con RUM

- Correlacionar logs y tests

- Guías

- Solucionar problemas

- Code Coverage

- Quality Gates

- Métricas de DORA

- Feature Flags

- Seguridad

- Información general de seguridad

- Cloud SIEM

- Code Security

- Cloud Security Management

- Application Security Management

- Workload Protection

- Sensitive Data Scanner

- Observabilidad de la IA

- Log Management

- Observability Pipelines

- Gestión de logs

- CloudPrem

- Administración

- Gestión de cuentas

- Seguridad de los datos

- Ayuda

Monitorización

Este producto no es compatible con el sitio Datadog seleccionado. ().

Información general

Explora y analiza tus aplicaciones LLM en producción con herramientas para consultar, visualizar, correlacionar e investigar datos en trazas (traces), clústeres y otros recursos.

Monitoriza el rendimiento, corrige los problemas, evalúa la calidad y protege tus sistemas basados en LLM con una visibilidad unificada de trazas, métricas y evaluaciones en línea.

Monitorización del rendimiento en tiempo real

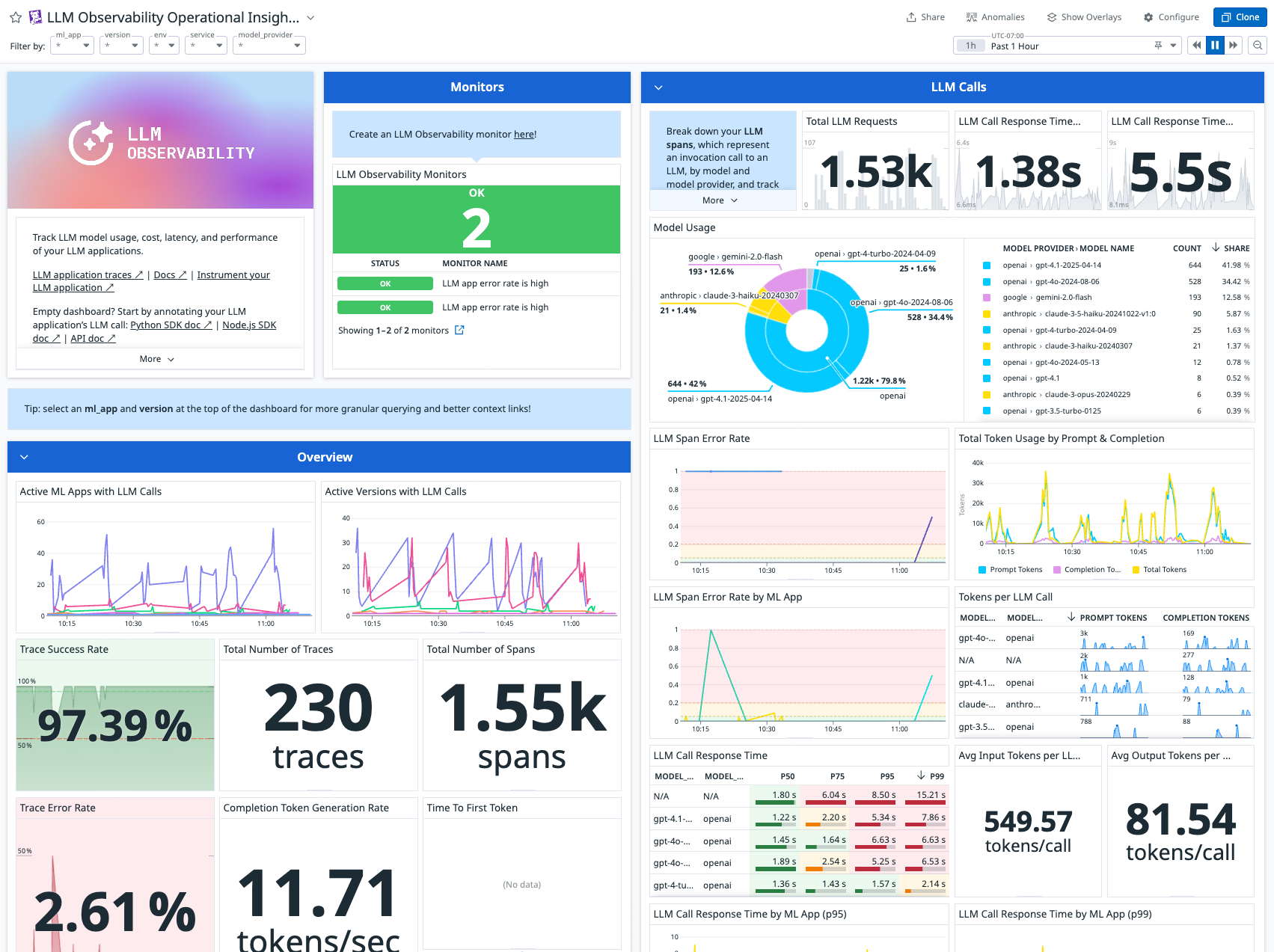

Monitoriza el estado operativo de tu aplicación LLM con métricas y dashboards integrados:

- Volumen y latencia de solicitudes: Realiza un seguimiento de las solicitudes por segundo, los tiempos de respuesta y los cuellos de botella de rendimiento en diferentes modelos, operaciones y endpoints.

- Seguimiento de errores: Monitoriza errores HTTP, tiempos de espera del modelo y solicitudes fallidas con el contexto de error detallado.

- Consumo de tokens: Realiza un seguimiento de los tokens de solicitudes, los tokens almacenados en caché, los tokens de finalización y el uso total para optimizar los costes.

- Análisis del uso de modelos: Monitoriza qué modelos están siendo llamandos, sus frecuencias y sus características de rendimiento.

El dashboard de información operativa de LLM Observability proporciona vistas consolidadas de métricas a nivel de traza y de tramo, índices de error, desgloses de latencia, tendencias de consumo de tokens y monitores activados.

Corrección y resolución de problemas de producción

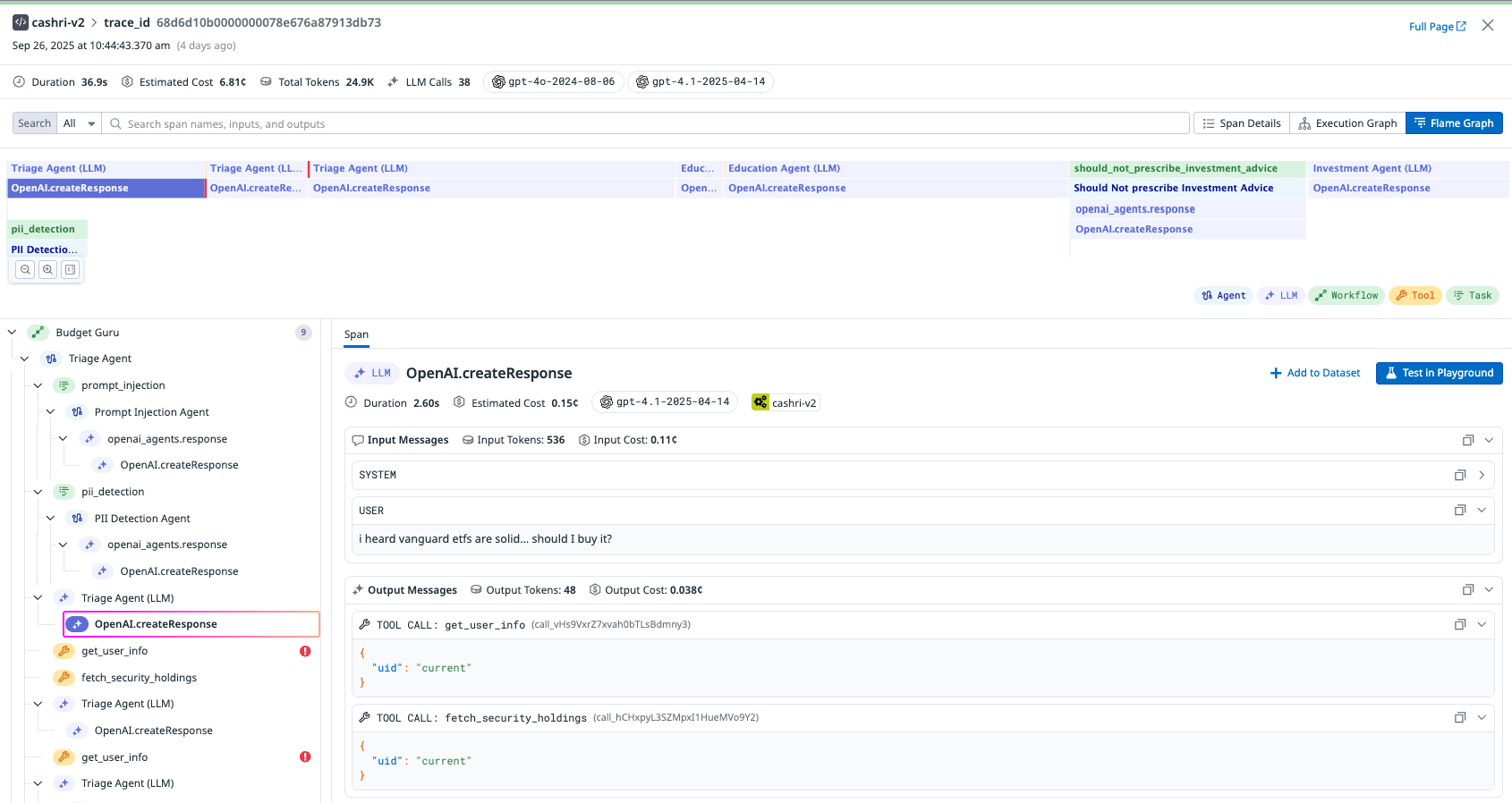

Depura flujos de trabajo LLM complejos con una visibilidad detallada de la ejecución:

- Análisis de trazas de extremo a extremo: Visualiza los flujos completos de solicitudes, desde la entrada del usuario hasta las llamadas al modelo, las llamadas a las herramientas y la generación de respuestas.

- Depuración a nivel de tramo: Examina las operaciones individuales dentro de las cadenas, incluyendo los pasos de preprocesamiento, las llamadas al modelo y la lógica de postprocesamiento.

- Identificación de las causas de error: Identifica los puntos de fallo en las cadenas de varios pasos, los flujos de trabajo o las operaciones agénticas con información detallada del contexto y el momento del error.

- Identificación de los cuellos de botella: Busca las operaciones lentas y optimízalas en función de los desgloses de latencia de los componentes de flujos de trabajo.

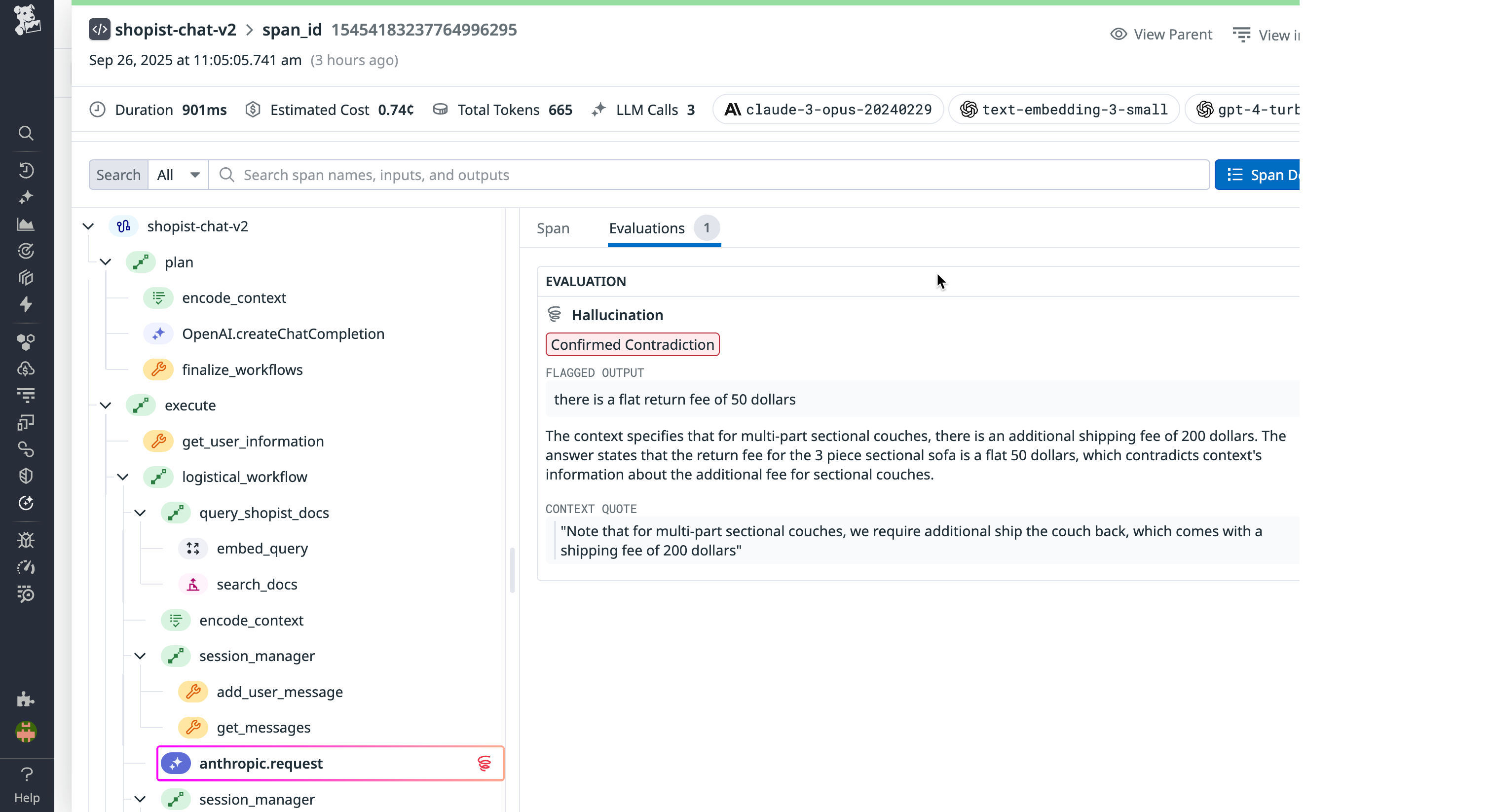

Evaluaciones de calidad y seguridad

Asegúrate de que tus agentes o aplicaciones LLM cumplen las normas de calidad con evaluaciones en línea. Para obtener información completa sobre las evaluaciones alojadas y gestionadas en Datadog, la ingesta de evaluaciones personalizadas y las funciones de monitorización de la seguridad, consults la documentación sobre evaluaciones.

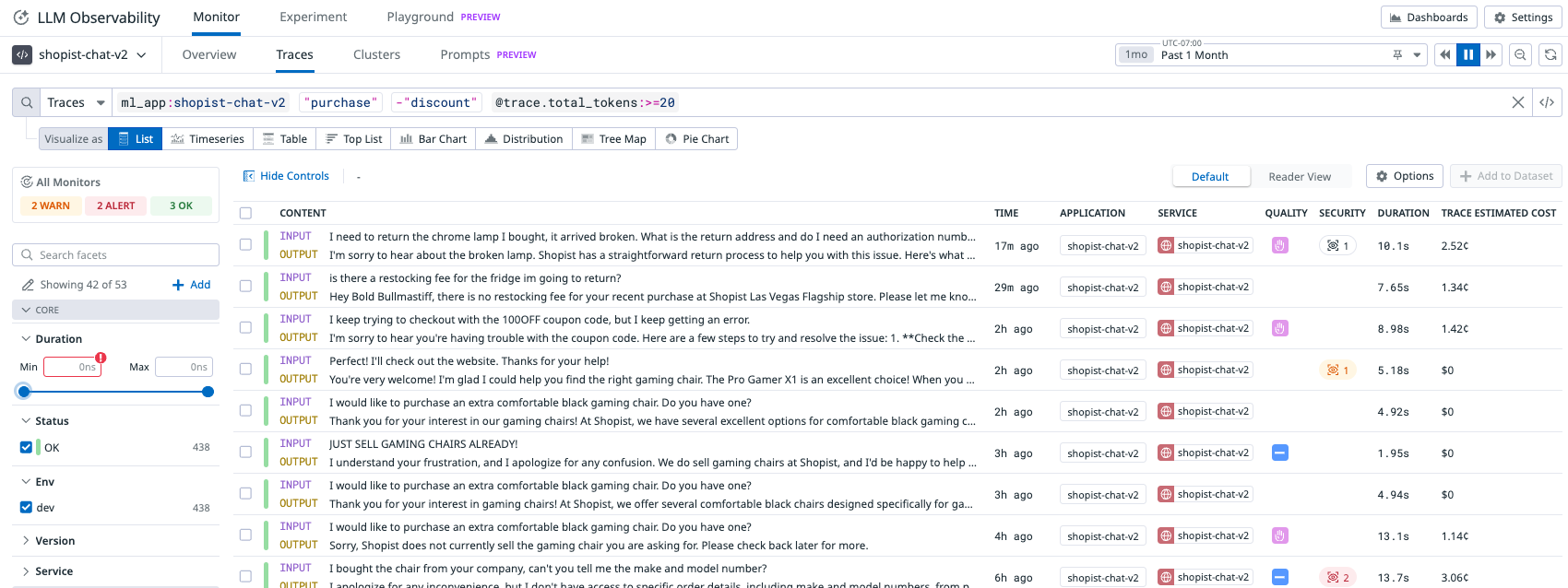

Consultar trazas y tramos de tu aplicación LLM

Aprende a utilizar la interfaz de consulta de LLM Observability de Datadog para buscar, filtrar y analizar las trazas y los tramos generados por tus aplicaciones LLM. La documentación sobre consultas explica cómo hacerlo:

- Utiliza la barra de búsqueda para filtrar las trazas y los tramos por atributos como modelo, usuario o estado de error.

- Aplica filtros avanzados para centrarte en operaciones o plazos específicos de LLM.

- Visualiza e inspecciona detalles de trazas para solucionar problemas y optimizar tus flujos de trabajo LLM.

Esto te permite identificar rápidamente los problemas, monitorizar el rendimiento y obtener información sobre el comportamiento de tu aplicación LLM en producción.

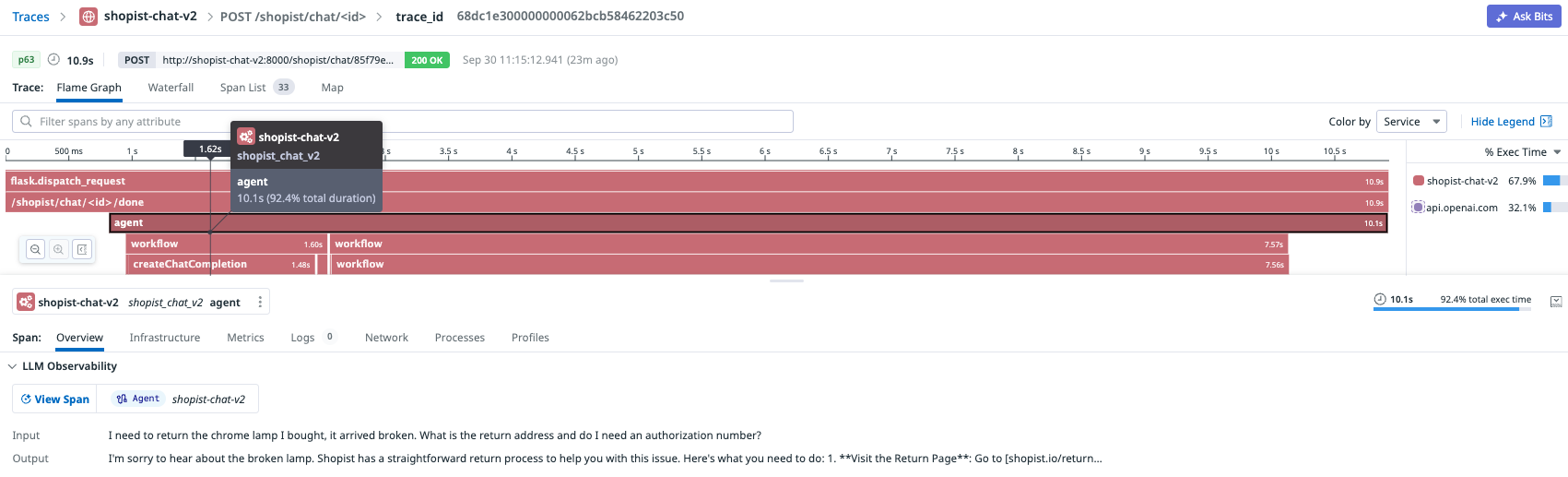

Correlacionar APM y LLM Observability

Para aplicaciones instrumentadas con Datadog APM, puedes correlacionar APM y LLM Observability a través del SDK. Correlacionar APM con LLM Observability proporciona visibilidad completa de extremo a extremo y análisis exhaustivos, desde problemas de aplicaciones hasta causas raíz específicas de LLM.

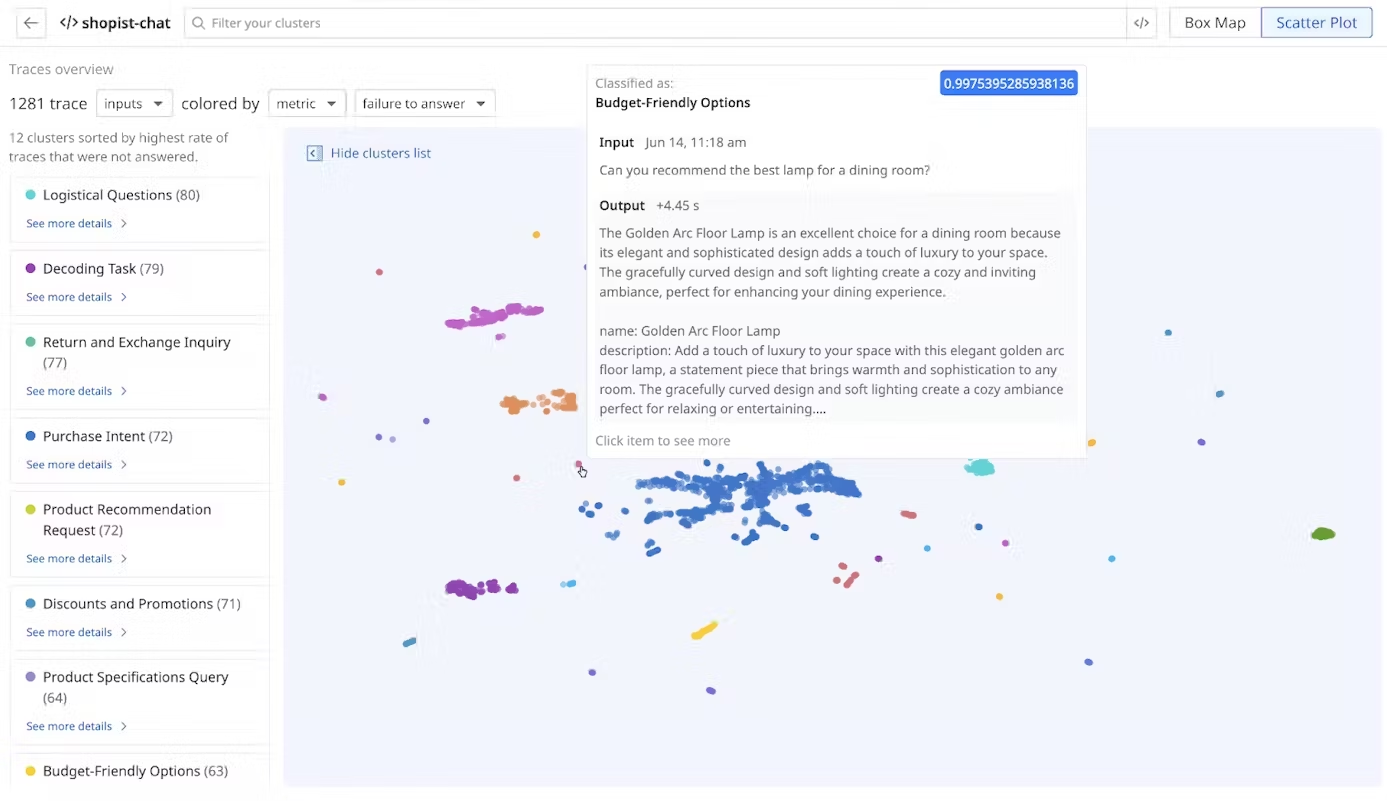

Mapa de clústeres

El mapa de clústeres proporciona información general de cómo se agrupan y relacionan las solicitudes de tu aplicación LLM. Te ayuda a identificar patrones, grupos de actividad similar y outliers en trazas LLM, lo que facilita la investigación de problemas y optimiza el rendimiento.

Monitorizar tus sistemas agénticos

Aprende cómo monitorizar aplicaciones LLM agénticas que utilizan múltiples herramientas o cadenas de razonamiento con Agent Monitoring de Datadog. Esta característica te ayuda a realizar un seguimiento de las acciones de los agentes, el uso de herramientas y los pasos de razonamiento, proporcionándote una visibilidad de complejos flujos de trabajo LLM y permitiéndote solucionar problemas y optimizar los sistemas agénticos de manera efectiva. Consulta la documentación de Agent Monitoring para ver más detalles.