- Esenciales

- Empezando

- Agent

- API

- Rastreo de APM

- Contenedores

- Dashboards

- Monitorización de bases de datos

- Datadog

- Sitio web de Datadog

- DevSecOps

- Gestión de incidencias

- Integraciones

- Internal Developer Portal

- Logs

- Monitores

- OpenTelemetry

- Generador de perfiles

- Session Replay

- Security

- Serverless para Lambda AWS

- Software Delivery

- Monitorización Synthetic

- Etiquetas (tags)

- Workflow Automation

- Centro de aprendizaje

- Compatibilidad

- Glosario

- Atributos estándar

- Guías

- Agent

- Arquitectura

- IoT

- Plataformas compatibles

- Recopilación de logs

- Configuración

- Automatización de flotas

- Solucionar problemas

- Detección de nombres de host en contenedores

- Modo de depuración

- Flare del Agent

- Estado del check del Agent

- Problemas de NTP

- Problemas de permisos

- Problemas de integraciones

- Problemas del sitio

- Problemas de Autodiscovery

- Problemas de contenedores de Windows

- Configuración del tiempo de ejecución del Agent

- Consumo elevado de memoria o CPU

- Guías

- Seguridad de datos

- Integraciones

- Desarrolladores

- Autorización

- DogStatsD

- Checks personalizados

- Integraciones

- Build an Integration with Datadog

- Crear una integración basada en el Agent

- Crear una integración API

- Crear un pipeline de logs

- Referencia de activos de integración

- Crear una oferta de mercado

- Crear un dashboard de integración

- Create a Monitor Template

- Crear una regla de detección Cloud SIEM

- Instalar la herramienta de desarrollo de integraciones del Agente

- Checks de servicio

- Complementos de IDE

- Comunidad

- Guías

- OpenTelemetry

- Administrator's Guide

- API

- Partners

- Aplicación móvil de Datadog

- DDSQL Reference

- CoScreen

- CoTerm

- Remote Configuration

- Cloudcraft

- En la aplicación

- Dashboards

- Notebooks

- Editor DDSQL

- Reference Tables

- Hojas

- Monitores y alertas

- Watchdog

- Métricas

- Bits AI

- Internal Developer Portal

- Error Tracking

- Explorador

- Estados de problemas

- Detección de regresión

- Suspected Causes

- Error Grouping

- Bits AI Dev Agent

- Monitores

- Issue Correlation

- Identificar confirmaciones sospechosas

- Auto Assign

- Issue Team Ownership

- Rastrear errores del navegador y móviles

- Rastrear errores de backend

- Manage Data Collection

- Solucionar problemas

- Guides

- Change Tracking

- Gestión de servicios

- Objetivos de nivel de servicio (SLOs)

- Gestión de incidentes

- De guardia

- Status Pages

- Gestión de eventos

- Gestión de casos

- Actions & Remediations

- Infraestructura

- Cloudcraft

- Catálogo de recursos

- Universal Service Monitoring

- Hosts

- Contenedores

- Processes

- Serverless

- Monitorización de red

- Cloud Cost

- Rendimiento de las aplicaciones

- APM

- Términos y conceptos de APM

- Instrumentación de aplicación

- Recopilación de métricas de APM

- Configuración de pipelines de trazas

- Correlacionar trazas (traces) y otros datos de telemetría

- Trace Explorer

- Recommendations

- Code Origin for Spans

- Observabilidad del servicio

- Endpoint Observability

- Instrumentación dinámica

- Live Debugger

- Error Tracking

- Seguridad de los datos

- Guías

- Solucionar problemas

- Límites de tasa del Agent

- Métricas de APM del Agent

- Uso de recursos del Agent

- Logs correlacionados

- Stacks tecnológicos de llamada en profundidad PHP 5

- Herramienta de diagnóstico de .NET

- Cuantificación de APM

- Go Compile-Time Instrumentation

- Logs de inicio del rastreador

- Logs de depuración del rastreador

- Errores de conexión

- Continuous Profiler

- Database Monitoring

- Gastos generales de integración del Agent

- Arquitecturas de configuración

- Configuración de Postgres

- Configuración de MySQL

- Configuración de SQL Server

- Configuración de Oracle

- Configuración de MongoDB

- Setting Up Amazon DocumentDB

- Conexión de DBM y trazas

- Datos recopilados

- Explorar hosts de bases de datos

- Explorar métricas de consultas

- Explorar ejemplos de consulta

- Exploring Database Schemas

- Exploring Recommendations

- Solucionar problemas

- Guías

- Data Streams Monitoring

- Data Jobs Monitoring

- Data Observability

- Experiencia digital

- Real User Monitoring

- Pruebas y monitorización de Synthetics

- Continuous Testing

- Análisis de productos

- Entrega de software

- CI Visibility

- CD Visibility

- Deployment Gates

- Test Visibility

- Configuración

- Network Settings

- Tests en contenedores

- Repositories

- Explorador

- Monitores

- Test Health

- Flaky Test Management

- Working with Flaky Tests

- Test Impact Analysis

- Flujos de trabajo de desarrolladores

- Cobertura de código

- Instrumentar tests de navegador con RUM

- Instrumentar tests de Swift con RUM

- Correlacionar logs y tests

- Guías

- Solucionar problemas

- Code Coverage

- Quality Gates

- Métricas de DORA

- Feature Flags

- Seguridad

- Información general de seguridad

- Cloud SIEM

- Code Security

- Cloud Security Management

- Application Security Management

- Workload Protection

- Sensitive Data Scanner

- Observabilidad de la IA

- Log Management

- Observability Pipelines

- Gestión de logs

- CloudPrem

- Administración

- Gestión de cuentas

- Seguridad de los datos

- Ayuda

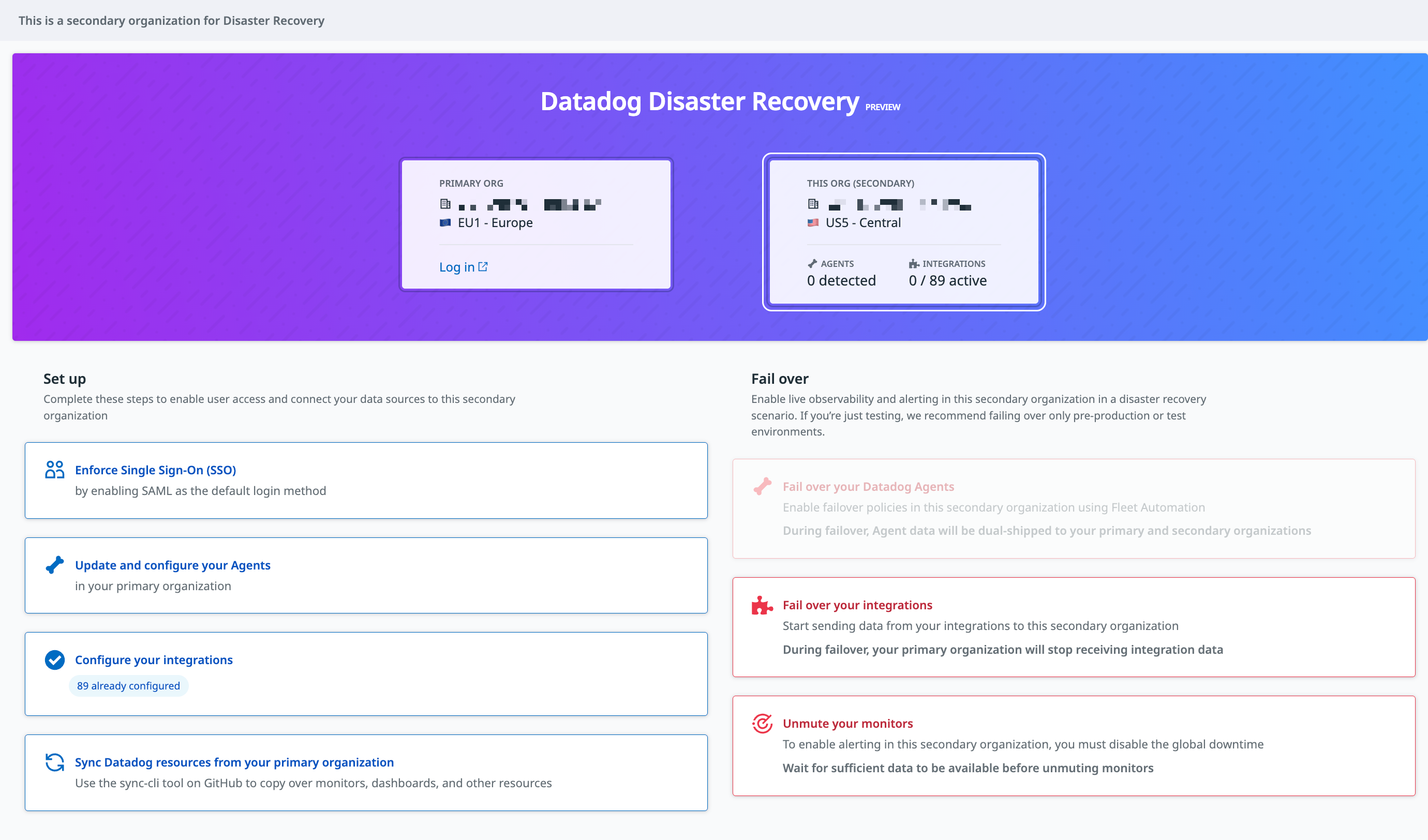

Datadog Disaster Recovery

Este producto no es compatible con el sitio Datadog seleccionado. ().

Join the Preview!

Datadog Disaster Recovery tiene disponibilidad limitada. Utiliza este formulario para solicitar acceso.

Request AccessInformación general

Datadog Disaster Recovery (DDR) te ofrece una continuidad de la observabilidad de aquellos eventos que pueden afectar a la región de un proveedor de servicios de nube o a los servicios de Datadog que se ejecutan dentro de la región de un proveedor de servicios de nube. Con DDR, puedes recuperar la observabilidad en tiempo real de un sitio Datadog alternativo y funcional, lo que te permite cumplir tus objetivos de disponibilidad de observabilidad crítica.

DDR también te permite realizar periódicamente simulacros de recuperación en caso de desastres, no solo para probar tu capacidad de recuperación en caso de interrupciones, sino también para satisfacer tus necesidades empresariales y de cumplimiento de las normativas.

Requisitos previos

La versión mínima del Datadog Agent que necesitas depende de los tipos de telemetría que necesites utilizar:

| Telemetría compatible | Productos compatibles | Versión del Agent requerida |

|---|---|---|

| Logs | Logs | v7.54 o posterior |

| Métricas | Infrastructure Monitoring | v7.54 o posterior |

| Trazas | APM | v7.68 o posterior |

Datadog evalúa continuamente las solicitudes de los clientes para que DDR sea compatible con otros productos. Ponte en contacto con el equipo de recuperación ante desastres para conocer las próximas funcionalidades y tus necesidades específicas, si no están cubiertas en puntos anteriores.

Configuración

Para activar Datadog Disaster Recovery, sigue estos pasos. Si tienes alguna duda sobre alguno de ellos, ponte en contacto con tu asesor de clientes o con el servicio de asistencia de Datadog.

1. Crea una organización DDR y vincúlala a tu organización principal.

Crear y compartir tu organización DDR

Crear y compartir tu organización DDR

Si es necesario, Datadog puede hacerlo por ti.

Crear tu organización DDR

- Ve a Empezando con Datadog. Es posible que tengas que salir de tu sesión actual o utilizar el modo incógnito para acceder a esta página.

- Elige un sitio Datadog distinto del principal (por ejemplo, si estás en

US1, eligeEUoUS5). - Sigue las instrucciones para crear una cuenta.

Todos los sitios Datadog están separados geográficamente. Consulta las opciones en la lista de sitios Datadog.

Si también envías telemetría a Datadog utilizando integraciones de proveedores de nube, debes añadir tus cuentas de proveedores de nube en la organización DDR. Datadog no utiliza proveedores de nube para recibir datos de telemetría mientras el sitio DDR está pasivo (no en conmutación por error).

Compartir la información de la organización DDR con Datadog

Envía por correo electrónico el nombre de tu nueva organización a tu [asesor de clientes] (mailto:success@datadoghq.com). A continuación, tu asesor de clientes establecerá esta nueva organización como tu organización DDR.

Nota: Aunque esta organización aparece en tu jerarquía de facturación de Datadog, todo el uso y coste asociado no se factura durante el periodo de vista previa.

Recuperar los ID públicos y vincular tu DDR y tus organizaciones primarias

Recuperar los ID públicos y vincular tu DDR y tus organizaciones primarias

Por razones de seguridad, Datadog no puede vincular las organizaciones en su nombre.

Una vez que el equipo de Datadog haya configurado tu organización DDR, utiliza el endpoint de API pública de Datadog para recuperar los ID públicos de la organización primaria y de la organización DDR.

Para vincular tus organizaciones DDR y primaria, ejecute estos comandos, sustituyendo los <PLACEHOLDERS> por los valores de tus organizaciones:

export PRIMARY_DD_API_KEY=<PRIMARY_ORG_API_KEY>

export PRIMARY_DD_APP_KEY=<PRIMARY_ORG_APP_KEY>

export PRIMARY_DD_API_URL=<PRIMARY_ORG_API_SITE>

export DDR_ORG_ID=<DDR_ORG_PUBLIC_ID>

export PRIMARY_ORG_ID=<PRIMARY_ORG_PUBLIC_ID>

export USER_EMAIL=<USER_EMAIL>

export CONNECTION='{"data":{"id":"'${PRIMARY_ORG_ID}'","type":"hamr_org_connections","attributes":{"TargetOrgUuid":"'${DDR_ORG_ID}'","HamrStatus":1,"ModifiedBy":"'${USER_EMAIL}'", "IsPrimary":true}}}'

curl -v -H "Content-Type: application/json" -H

"dd-api-key:${PRIMARY_DD_API_KEY}" -H

"dd-application-key:${PRIMARY_DD_APP_KEY}" --data "${CONNECTION}" --request POST ${PRIMARY_DD_API_URL}/api/v2/hamr

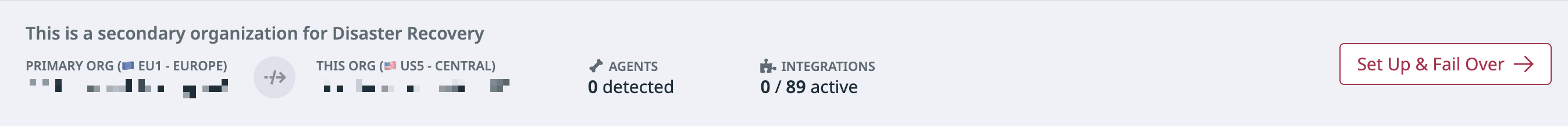

Después de vincular tus organizaciones, solo la organización de conmutación por error muestra este banner:

2. Configurar el acceso, las integraciones, la sincronización y los agentes

Configurar el inicio de sesión único para la organización DDR

Configurar el inicio de sesión único para la organización DDR

Datadog recomienda utilizar el inicio de sesión único (SSO) para que todos los usuarios puedan iniciar sesión sin problemas en tu organización de recuperación ante desastres durante una interrupción.

Ve a Configuración de la organización en tu organización DDR para configurar SAML o Google Login para tus usuarios.

Debes invitar a cada uno de tus usuarios a tu organización de recuperación ante desastres y otorgarles los roles y permisos adecuados. Como alternativa, para agilizar esta operación, puede utilizar el aprovisionamiento justo a tiempo con SAML.

Configurar tus integraciones en la nube (AWS, Azure, Google Cloud)

Configurar tus integraciones en la nube (AWS, Azure, Google Cloud)

Consulta los pasos de configuración de las integraciones AWS, Azure y Google Cloud.

Tus integraciones en la nube deben configurarse tanto en la organización principal como en la DDR. Sin embargo, las integraciones solo deben ejecutarse en una organización a la vez:

- Por defecto, las integraciones deben ejecutarse solo en la organización primaria.

- Cuando están en conmutación por error, las integraciones solo deben ejecutarse en la organización DDR.

Para obtener más información, consulta la sección sobre conmutación por error en integraciones de nube.

Crear tu clave de API y de aplicación Datadog para la sincronización

Crear tu clave de API y de aplicación Datadog para la sincronización

En tu organización DDR de Datadog, crea un conjunto de clave de API y clave de aplicación. Son útiles para copiar dashboards y monitores entre sitios Datadog.

Datadog puede ayudarte a copiar las firmas de las claves API de tus Agents en la cuenta de copia de seguridad DDR. De este modo, no es necesario crear nuevas claves de API cuando se opera en la región DDR. Al utilizar las claves existentes, puedes evitar la complejidad de gestionar varios conjuntos de claves, reducir la sobrecarga operativa y simplificar la gestión de claves. Si tienes alguna pregunta, ponte en contacto con tu asesor de clientes.

Configurar la sincronización de recursos en un cronograma

Configurar la sincronización de recursos en un cronograma

Uso de la herramienta datadog-sync-cli

Utiliza la herramienta datadog-sync-cli para copiar tus dashboards, monitores y otras configuraciones de tu organización primaria a tu organización DDR.

La herramienta datadog-sync-cli está pensada principalmente para copiar y actualizar recursos de forma unidireccional desde tu organización principal a tu organización DDR. Los recursos copiados a la organización DDR pueden editarse, pero cualquier nueva sincronización anula los cambios que difieran de la fuente en la organización primaria.

La sincronización periódica es esencial para garantizar que tu organización DDR está actualizada en caso de desastre. Datadog recomienda realizar esta operación diariamente; puedes determinar la frecuencia y el momento de la sincronización en función de tus necesidades empresariales. Para obtener información sobre la configuración y ejecución del proceso de copia de seguridad, consulta el datadog-sync-cli README.

Utiliza la configuración datadog-sync-cli disponible en la documentación para añadir cada elemento al contexto de sincronización. A continuación se muestra un ejemplo de archivo de configuración para sincronizar dashboards y monitores específicos utilizando el filtrado de nombres y etiquetas desde un sitio EU a un sitio US5:

destination_api_url="https://api.us5.datadoghq.com"

destination_api_key="<US5_API_KEY>"

destination_app_key="<US5_APP_KEY>"

source_api_key="<EU_API_KEY>"

source_app_key="<EU_APP_KEY>"

source_api_url="https://api.datadoghq.eu"

filter=["Type=Dashboards;Name=title","Type=Monitors;Name=tags;Value=sync:true"]

# Asegúrate de aumentar el tiempo de reintento para hacer frente al límite de velocidad

http_client_retry_timeout=600

Este es un ejemplo de un comando datadog-sync-cli para sincronizar configuraciones de logs:

datadog-sync migrate –config config –resources="users,roles,logs_pipelines,logs_pipelines_order,logs_indexes,logs_indexes_order,logs_metrics,logs_restriction_queries" –cleanup=Force

Limitación datadog-sync-cli para atributos estándar de logs

La datadog-sync-cli se actualiza regularmente con nuevos recursos. En este momento, la sincronización de atributos estándar de logs no es compatible con la beta privada. Si utilizas atributos estándar con tus pipelines de logs y estás reasignando tus logs, los atributos son una dependencia que necesitas reconfigurar manualmente en tu organización DDR. Consulta la documentación sobre atributos estándar de Datadog para obtener ayuda.

La datadog-sync-cli se actualiza regularmente con nuevos recursos. En este momento, la sincronización de atributos estándar de logs no es compatible con la beta privada. Si utilizas atributos estándar con tus pipelines de logs y estás reasignando tus logs, los atributos son una dependencia que necesitas reconfigurar manualmente en tu organización DDR. Consulta la documentación sobre atributos estándar de Datadog para obtener ayuda.

Verificar la disponibilidad en el sitio DDR

Verifica que tu organización DDR es accesible y que tus dashboards y monitores se copian de tu organización primaria a tu organización DDR.

Si necesitas ayuda, ponte en contacto con tu asesor de clientes o con el servicio de asistencia de Datadog.

Activar la configuración remota [**RECOMENDADO]

Activar la configuración remota [**RECOMENDADO]

La Configuración remota (RC) te permite configurar y cambiar de forma remota el comportamiento de los Datadog Agents desplegados en tu infraestructura.

La Configuración remota está habilitada por defecto para las nuevas organizaciones, incluyendo tu organización DDR. Todas las nuevas claves de API que crees estarán habilitadas para su uso con tu Agent. Para ver más detalles, consulta la documentación de configuración remota.

Datadog recomienda encarecidamente el uso de la configuración remota para un control de conmutación por error más continuo. Como alternativa a la configuración remota, puedes configurar manualmente tus Agents o utilizar herramientas de gestión de la configuración como Puppet, Ansible o Chef.

Envío dual de telemetría a organizaciones DDR durante conmutaciones por error o simulacros

Envío dual de telemetría a organizaciones DDR durante conmutaciones por error o simulacros

El Envío dual permite enviar simultáneamente los mismos datos a dos organizaciones diferentes, como por ejemplo una organización primaria y otra de conmutación por error. A partir del Agent v7.54 o posteriores, una nueva configuración de DDR permite a los Datadog Agents enviar Datos que se envían a la plataforma Datadog. Por ejemplo, logs, metrics, traces. que se designan como organizaciones de conmutación por error cuando se activa la conmutación por error.

El envío dual está desactivado por defecto, pero puedes activarlo para respaldar tus ejercicios y simulacros periódicos de recuperación ante desastres.

Para habilitar el envío dual, Datadog recomienda utilizar Fleet Automation para facilitar la gestión y la escalabilidad. Alternativamente, puedes configurarlo manualmente editando tu archivo datadog.yaml.

Ponte en contacto con tu asesor de clientes de Datadog para programar intervalos de tiempo exclusivos para realizar tests de conmutación por error, para medir el rendimiento y el objetivo de tiempo de recuperación (RTO).

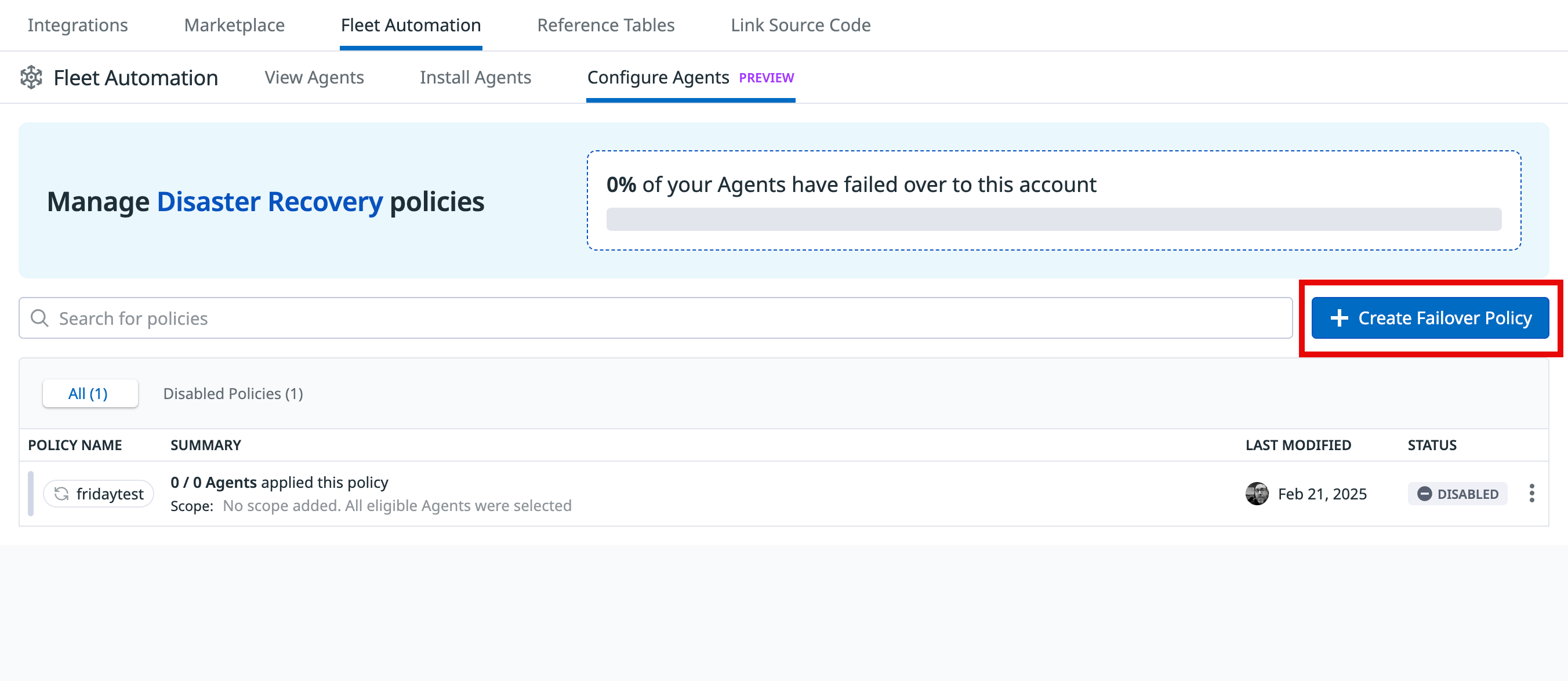

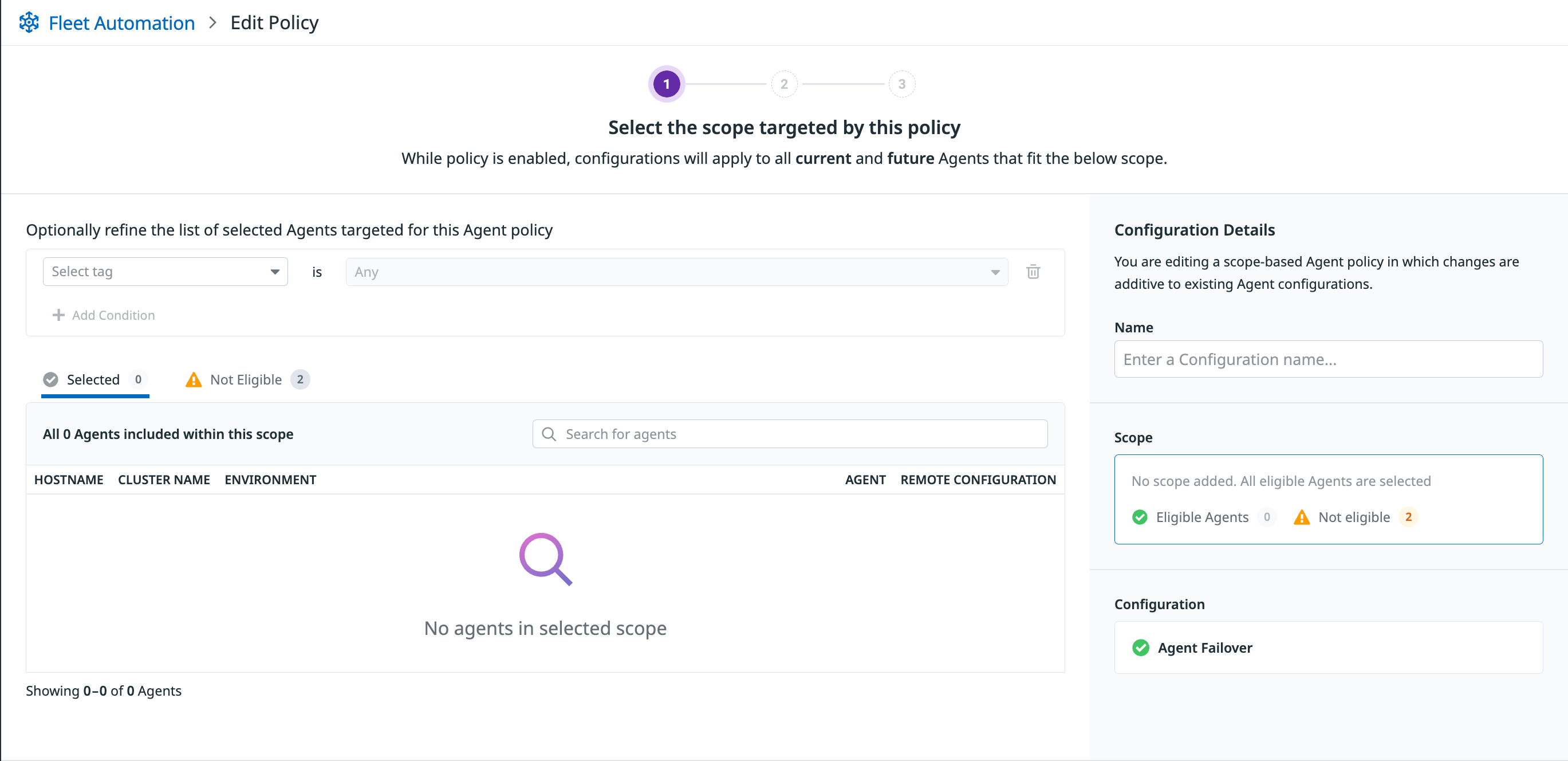

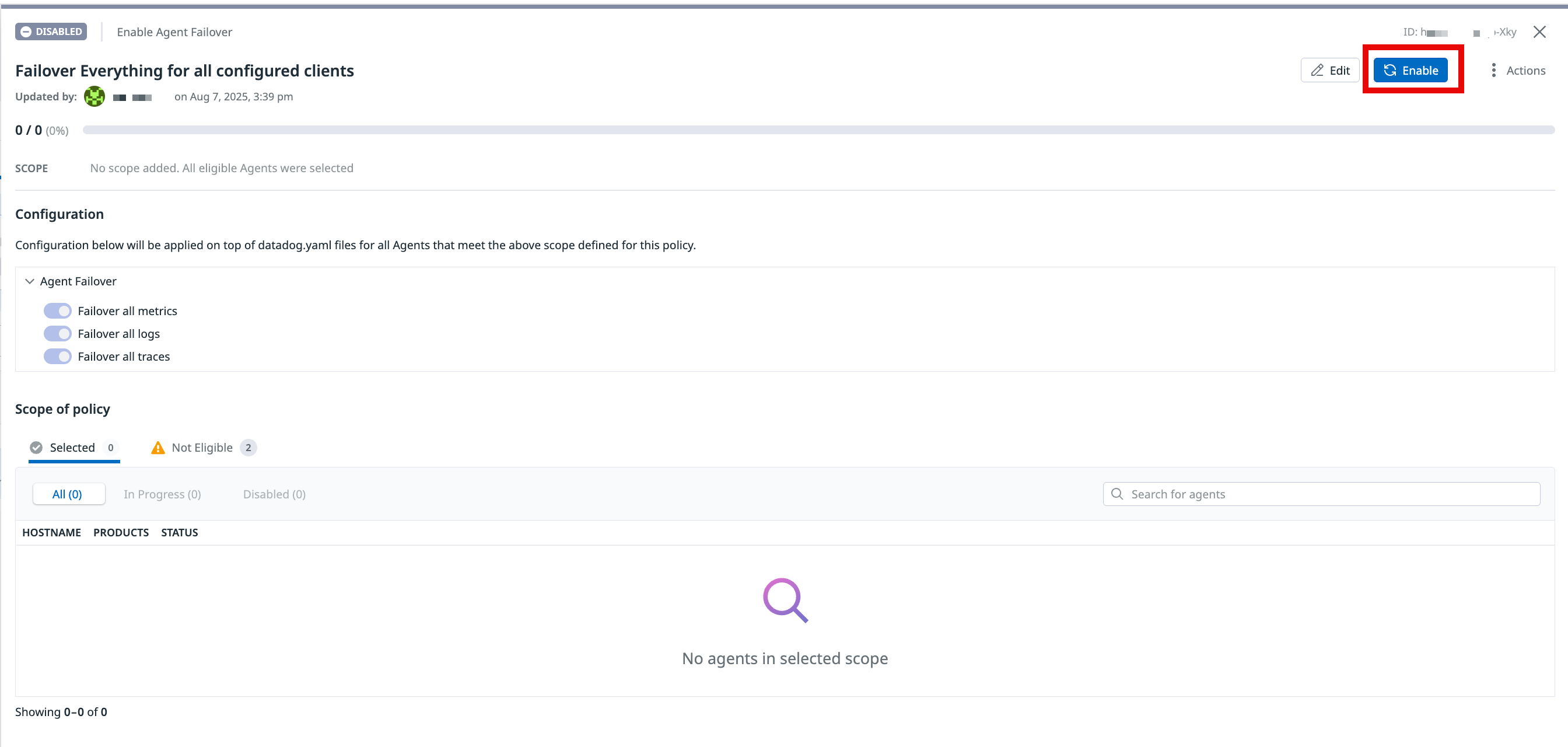

Desde la página Fleet Automation de tu organización de conmutación por error, en la pestaña Configure Agents (Configurar Agents), puedes crear una nueva política de conmutación por error o reutilizar una existente y aplicarla a tu flota de Agents. Poco después de habilitar la política, los Agents comienzan a enviar telemetría de forma dual, tanto al sitio de observabilidad primario como al de DDR (conmutación por error).

Para crear una política de conmutación por error, haz clic en Create Failover Policy (Crear política de conmutación por error).

Luego, sigue las instrucciones para delimitar los hosts y la telemetría (métricas, logs, trazas) que debes conmutar por error.

Nota: Las integraciones en la nube solo pueden ejecutarse en tu sitio primario o en el sitio DDR Datadog, pero no en ambos al mismo tiempo, por lo que su conmutación por error hará que cesen los datos de la integración en la nube en tu sitio primario. Durante la conmutación por error de una integración, las integraciones solo se ejecutan en el centro de datos DDR. Cuando ya no esté en conmutación por error, desactiva la política de conmutación por error para devolver la recopilación de datos de la integración a la organización primaria.

Durante una conmutación por error o ejercicios de conmutación por error, actualiza el archivo de configuración datadog.yaml del Datadog Agent como se muestra en el siguiente ejemplo y reinicia el Agent.

enabled: truepermite al Agent enviar Datos del Agent y el host de infraestructura. Por ejemplo,host name,host tags,Agent version. al sitio DDR Datadog para que puedas ver los Agents y tus hosts de Infra en la organización DDR. Esto te permite ver tus Agents y hosts de infraestructura en la organización de conmutación por error.failover_metrics,failover_logs, yfailover_apmsonfalsepor defecto. Configurarlos comotruehace que el Agent comience a enviar Datos que se envían a la plataforma Datadog. Por ejemplo,logs,metrics,traces. a la organización DDR.

multi_region_failover:

enabled: true

failover_metrics: false

failover_logs: false

failover_apm: false

site: <DDR_SITE> # For example "site: us5.datadoghq.com" for a US5 site

api_key: <DDR_SITE_API_KEY>

3. Ejecutar tests de conmutación por error en varios entornos

Activar y probar la conmutación por error DDR en entornos basados en el Agent

Activar y probar la conmutación por error DDR en entornos basados en el Agent

Para activar una conmutación por error de tus Agents, puedes hacer clic en una de las políticas en Fleet Automation de tu organización DDR y luego hacer clic en Enable (Activar). El estado de cada host se actualiza a medida que se produce la conmutación por error.

Sigue los pasos correspondientes a tu entorno para activar/probar la conmutación por error DDR.

Para despliegues del Agent en entornos no contenerizados, utiliza los siguientes comandos CLI del Agent:

agent config set multi_region_failover.failover_metrics true

agent config set multi_region_failover.failover_logs true

agent config set multi_region_failover.failover_apm true

Si estás ejecutando el Agent en un entorno contenedorizado como Kubernetes, puedes seguir utilizando la herramienta de línea de comandos del Agent, pero necesitas invocarla en el contenedor que ejecuta el Agent. Puedes realizar cambios utilizando una de las siguientes opciones, dependiendo de tus necesidades:

Uso de kubectl

A continuación se muestra un ejemplo de uso de kubectl para conmutar por error las métricas y logs de un pod del Datadog Agent desplegado con el Helm chart oficial o Datadog Operator. El <POD_NAME> debe sustituirse por el nombre del pod del Agent:

kubectl exec <POD_NAME> -c agent -- agent config set multi_region_failover.failover_metrics true

kubectl exec <POD_NAME> -c agent -- agent config set multi_region_failover.failover_logs true

kubectl exec <POD_NAME> -c agent -- agent config set multi_region_failover.failover_apm true

Uso del archivo de configuración del Agent

Como alternativa, puedes especificar los siguientes parámetros en el archivo de configuración principal del Agent (datadog.yaml) y reiniciar el Datadog Agent para que se apliquen los cambios:

multi_region_failover:

enabled: true

failover_metrics: true

failover_logs: true

failover_apm: true

site: NEW_ORG_SITE

api_key: NEW_SITE_API_KEY

Uso de Helm chart o Datadog Operator

Puedes realizar cambios similares con el Helm chart oficial o Datadog Operator si necesitas especificar una configuración personalizada. De lo contrario, puedes pasar los parámetros como variables de entorno:

DD_MULTI_REGION_FAILOVER_ENABLED=true

DD_MULTI_REGION_FAILOVER_FAILOVER_METRICS=true

DD_MULTI_REGION_FAILOVER_FAILOVER_LOGS=true

DD_MULTI_REGION_FAILOVER_FAILOVER_APM=true

DD_MULTI_REGION_FAILOVER_SITE=ADD_NEW_ORG_SITE

DD_MULTI_REGION_FAILOVER_API_KEY=ADD_NEW_SITE_API_KEY

Activar y probar la conmutación por error DDR en integraciones en la nube

Activar y probar la conmutación por error DDR en integraciones en la nube

Puedes probar la conmutación por error de tus integraciones en la nube desde la página de inicio del DDR de tu organización.

En la página de conmutación por error, puedes comprobar el estado de tu organización DDR o hacer clic en Fail over your integrations (Realizar conmutación por error de tus integraciones) para probar la conmutación por error de tu integración en la nube.

Cuando ya no esté en conmutación por error, desactiva la política de conmutación por error en la organización DDR para devolver la recopilación de datos de la integración a la organización principal.

Durante la prueba, la telemetría de la integración se reparte entre ambas organizaciones. Si cancelas una prueba de conmutación por error, las integraciones vuelven a ejecutarse en el centro de datos primario.

Referencias adicionales

Más enlaces, artículos y documentación útiles: